En este tutorial, aprenderás a configurar y desplegar tus primeros modelos de Inteligencia Artificial para detección de objetos y estimación de poses utilizando la reComputer J4011. Te guiaremos paso a paso, desde la preparación del entorno en NVIDIA Jetson Orin NX hasta la ejecución de modelos preentrenados del repositorio jetson-inference, permitiéndote aprovechar la potencia del Edge AI para procesar visión artificial en tiempo real y sin depender de la nube.

Introducción

En el mundo de la automatización moderna, la velocidad lo es todo. La reComputer J4011, equipada con el módulo NVIDIA Jetson Orin NX, representa un salto cuántico para los desarrolladores que buscan llevar la Inteligencia Artificial más allá del escritorio. A través de este tutorial, exploraremos cómo transformar esta compacta computadora en un motor de visión artificial de alto rendimiento. No solo configuraremos el sistema desde cero, sino que daremos vida a la cámara ejecutando redes neuronales avanzadas capaces de “entender” su entorno mediante la detección de objetos y el análisis de poses humanas en milisegundos. Si estás listo para dominar el procesamiento en el borde (Edge AI) y crear aplicaciones inteligentes que no dependen de una conexión a internet, este es el punto de partida ideal.

Materiales

- reComputer J4011 Computadora Edge AI con NVIDIA Jetson Orin NX de 8 GB

- Monitor, HDMI.

- Cable Ethernet.

- Mouse y teclado.

- Cámara (USB / CSI)

Desarrollo

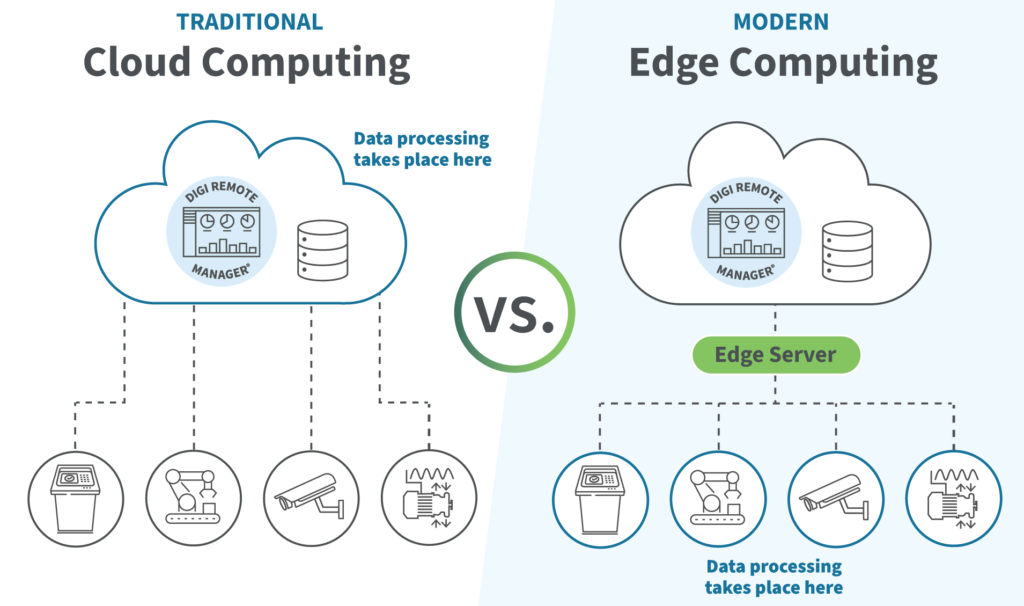

¿Qué es Edge Computing (Computación en el Borde)?

El Edge Computing (o computación en el borde) es una tecnología que consiste en procesar los datos lo más cerca posible de donde se generan, en lugar de enviarlos a un servidor lejano en la nube para que regresen con una respuesta. Imagina una cámara de seguridad inteligente: con el modelo tradicional, la cámara envía el video a internet, un servidor lo analiza y le avisa si hay un intruso; con Edge Computing, la cámara tiene un “pequeño cerebro” local que analiza las imágenes al instante sin necesidad de internet. Esto hace que las decisiones sean mucho más rápidas, ahorra ancho de banda y mejora la seguridad, ya que la información sensible no tiene que estar viajando por la red constantemente.

A diferencia de los sistemas convencionales que dependen de centros de datos remotos, la computación en el borde permite que el procesamiento de redes neuronales complejas ocurra directamente en el dispositivo. Esta arquitectura elimina la latencia intrínseca de la nube, garantizando respuestas en tiempo real que son críticas en aplicaciones de seguridad y robótica, al tiempo que refuerza la privacidad de los datos y reduce el consumo energético al evitar la transmisión masiva de información hacia servidores externos.

reComputer J4011 – Jetson Orin NX de 8 GB

La reComputer J4011 es mucho más que una computadora compacta; es una unidad de procesamiento de alto rendimiento diseñada específicamente para llevar la Inteligencia Artificial al “borde” (Edge). Construida sobre el módulo NVIDIA Jetson Orin NX de 8 GB, esta placa redefine lo que es posible en sistemas embebidos. Mientras que el Cloud Computing depende de enormes granjas de servidores distantes, la reComputer actúa como un nodo local ultra rápido. Su función es eliminar la dependencia total de la nube, permitiendo que el análisis de datos ocurra justo donde está la acción.

El corazón de esta unidad es su GPU NVIDIA Ampere con 1024 núcleos CUDA y núcleos Tensor de 3ª generación. A diferencia de una CPU normal, esta GPU está optimizada para realizar miles de cálculos matemáticos en paralelo, que es exactamente lo que los modelos de IA necesitan para “ver” y “entender”. Gracias a su arquitectura, puede ejecutar redes neuronales modernas como YOLO, MobileNet o PoseNet con una latencia mínima. Esto la hace ideal para aplicaciones en robótica autónoma, ciudades inteligentes, drones y manufactura industrial, donde un retraso de un segundo puede marcar la diferencia entre el éxito y un error crítico.

Preparativos

Una vez que hayas realizado el primer arranque de tu reComputer J4011 y configurado el entorno básico de Ubuntu, el siguiente paso es optimizar el sistema y preparar las herramientas de gestión. Antes de lanzar modelos de IA, es fundamental actualizar las dependencias y configurar el hardware para que entregue su máximo rendimiento.

Ejecuta los siguientes comandos en la terminal para instalar los paquetes necesarios:

# Actualización del sistema y repositorios

sudo apt update && sudo apt upgrade -y

# Protección de paquetes críticos del kernel (evita errores de compatibilidad)

sudo apt-mark hold nvidia-l4t-kernel nvidia-l4t-kernel-headers nvidia-l4t-kernel-dtbs nvidia-l4t-display-kernel

# Instalación del gestor de paquetes para Python 3

sudo apt install python3-pip -y

# Herramienta de monitoreo y control de energía (jtop)

sudo pip3 install jetson-stats

# Configurar la Jetson para trabajar a su máxima potencia (Modo Max-N)

sudo nvpmodel -m 0

# Es necesario reiniciar para aplicar los cambios de potencia y kernel

sudo rebootCon estos comandos, ya tienes tu sistema totalmente actualizado y configurado para trabajar a su máxima potencia. Ahora que el hardware está listo, es momento de preparar el acceso remoto para trabajar con mayor comodidad.

Habilitar VNC

Para facilitar el desarrollo, habilitaremos el acceso remoto mediante VNC. Esto te permitirá ver y controlar la interfaz gráfica de la reComputer desde cualquier otra computadora conectada a tu red local. NVIDIA recomienda utilizar Vino como servidor para esta tarea.

Sigue estos comandos para instalarlo y configurarlo:

# Instalación del servidor Vino

sudo apt update

sudo apt install vino -y

# Configuración para que el servicio inicie automáticamente

mkdir -p ~/.config/autostart

cp /usr/share/applications/vino-server.desktop ~/.config/autostart

# Ajustes de seguridad y visualización

gsettings set org.gnome.Vino prompt-enabled false

gsettings set org.gnome.Vino require-encryption false

# Configuración de contraseña (reemplaza 'tu_password' por la que prefieras)

gsettings set org.gnome.Vino authentication-methods "['vnc']"

gsettings set org.gnome.Vino vnc-password $(echo -n 'tu_password' | base64)

# Reinicia el sistema para aplicar los cambios

sudo rebootNota: Para asegurar que el servicio VNC se inicie correctamente al encender la placa, se recomienda configurar el usuario para que inicie sesión de forma automática (sin pedir contraseña en la pantalla de bloqueo).

Para conectarte, necesitarás conocer la dirección IP de tu dispositivo. Ejecuta el siguiente comando en la terminal:

ifconfigBusca el apartado de tu interfaz de red (usualmente eth0 si usas cable o wlan0 para WiFi) y localiza el número después de inet addr: o inet. Esa es la dirección que ingresarás en tu cliente VNC.

Ajustar la resolución de la pantalla

Para que la transmisión sea fluida y no sature la red, es recomendable fijar una resolución estándar (como 1280×800). Puedes hacerlo inyectando la configuración directamente en el archivo de video con este comando:

Agrega lo siguiente en el archivo /etc/X11/xorg.conf :

printf '\nSection "Screen"\n Identifier "Default Screen"\n Monitor "Configured Monitor"\n Device "Tegra0"\n SubSection "Display"\n Depth 24\n Virtual 1280 800\n EndSubSection\nEndSection\n' | sudo tee -a /etc/X11/xorg.conf > /dev/null¡Listo! Con esto ya tienes el control total de tu reComputer desde la comodidad de tu escritorio.

Configuración de Docker

Esta sección es vital porque Docker es el estándar de oro para trabajar con Inteligencia Artificial en dispositivos Jetson. Permite ejecutar modelos complejos en entornos aislados sin romper las dependencias del sistema operativo principal.

NVIDIA utiliza contenedores para distribuir sus herramientas de IA, lo que facilita enormemente la instalación de librerías como TensorRT o PyTorch. Aunque el entorno suele venir preinstalado, es fundamental asegurarnos de que el motor de Docker esté configurado para utilizar el hardware de NVIDIA por defecto.

Si no tienes instalados los paquetes de soporte para contenedores, ejecuta:

sudo apt update

sudo apt install -y nvidia-containerPara poder ejecutar Docker sin necesidad de usar sudo en cada comando y aplicar los permisos de usuario, utiliza:

sudo systemctl restart docker

sudo usermod -aG docker $USER

newgrp dockerEl siguiente paso es crucial. Por defecto, Docker utiliza el procesador (CPU) para ejecutar contenedores. Sin embargo, para IA necesitamos que utilice la GPU. El siguiente comando utiliza la herramienta jq para editar el archivo de configuración de Docker e indicarle que el motor de ejecución predeterminado sea el de NVIDIA:

# Configura NVIDIA como el runtime por defecto en Docker

sudo jq '. + {"default-runtime": "nvidia"}' /etc/docker/daemon.json | \

sudo tee /etc/docker/daemon.json.tmp && \

sudo mv /etc/docker/daemon.json.tmp /etc/docker/daemon.jsonFinalmente, reinicia el servicio para que Docker reconozca que ahora tiene permiso de usar toda la potencia de los núcleos CUDA:

sudo systemctl daemon-reload && sudo systemctl restart dockerListo, ahora el sistema sabe que cada vez que lances un contenedor, debe darle acceso directo a la GPU.

Ejecución de Modelos de IA con jetson-inference

Con el sistema optimizado, es momento de poner a prueba la reComputer. Utilizaremos el repositorio jetson-inference, una biblioteca de código abierto desarrollada por NVIDIA que permite implementar aplicaciones de aprendizaje profundo de manera eficiente. Este repositorio no solo contiene el código para ejecutar los modelos, sino que también gestiona la descarga de redes neuronales preentrenadas para clasificación, detección de objetos y segmentación.

Primero, creamos un directorio de trabajo y clonamos el repositorio de forma recursiva (para incluir todos los subcomponentes):

mkdir ~/Projects

cd ~/Projects

git clone --recursive https://github.com/dusty-nv/jetson-inference

cd jetson-inferenceEntrando al Contenedor de Desarrollo

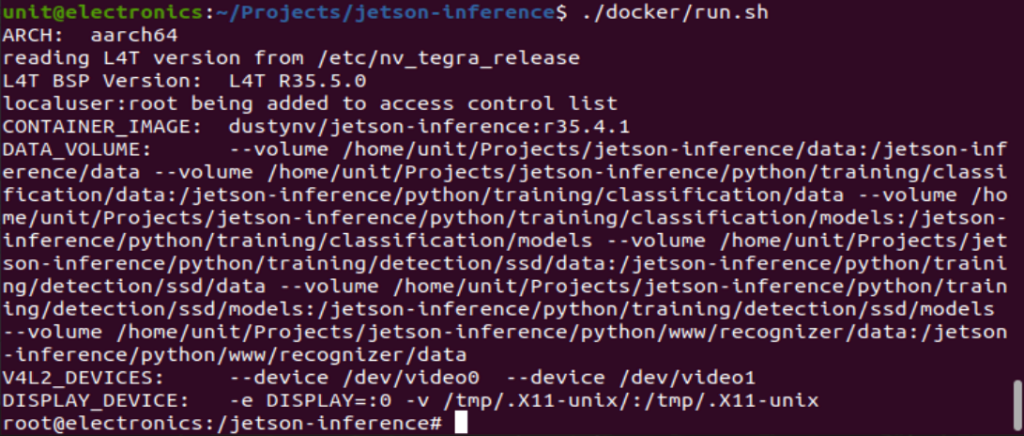

Para evitar conflictos de librerías, NVIDIA encapsula todo el entorno de ejecución en contenedores de Docker. Al ejecutar el siguiente script, entrarás en un entorno virtual que ya tiene cargadas todas las dependencias necesarias para interactuar con la cámara y la GPU:

./docker/run.shAl iniciar, verás en la terminal un resumen de las configuraciones: versiones de L4T (Linux for Tegra), dispositivos de video detectados (como /dev/video0) y los volúmenes montados.

Inicialización de contenedor.

Mi primer “Hola mundo” con IA

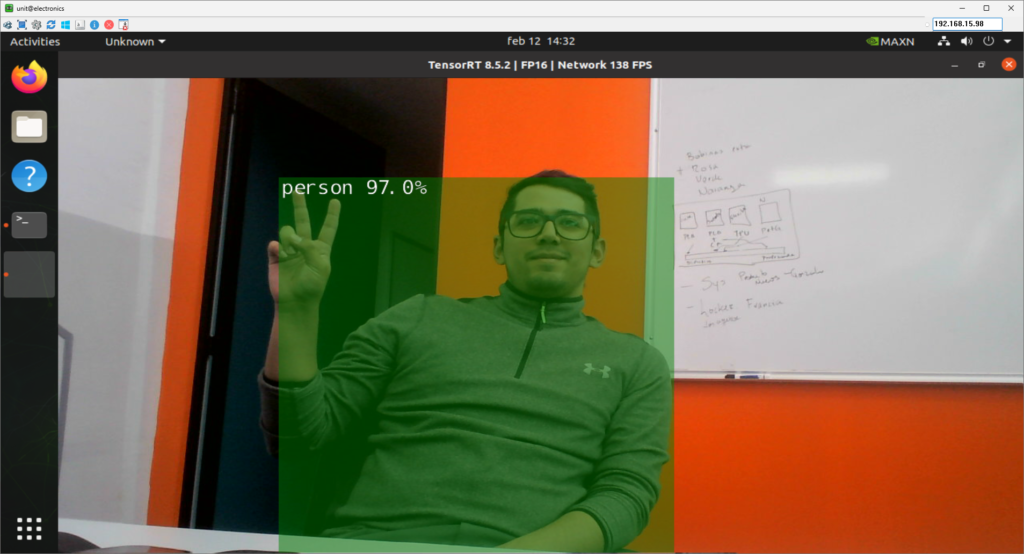

El modelo detectnet es el punto de partida ideal. Utiliza redes como SSD-Mobilenet para identificar y localizar múltiples objetos en una imagen simultáneamente. Para lanzarlo usando tu cámara, ejecuta:

detectnet /dev/video0Nota: La primera vez que lo ejecutes, el sistema tardará unos minutos en compilar el motor de TensorRT para optimizar el modelo específicamente para tu GPU Orin NX.

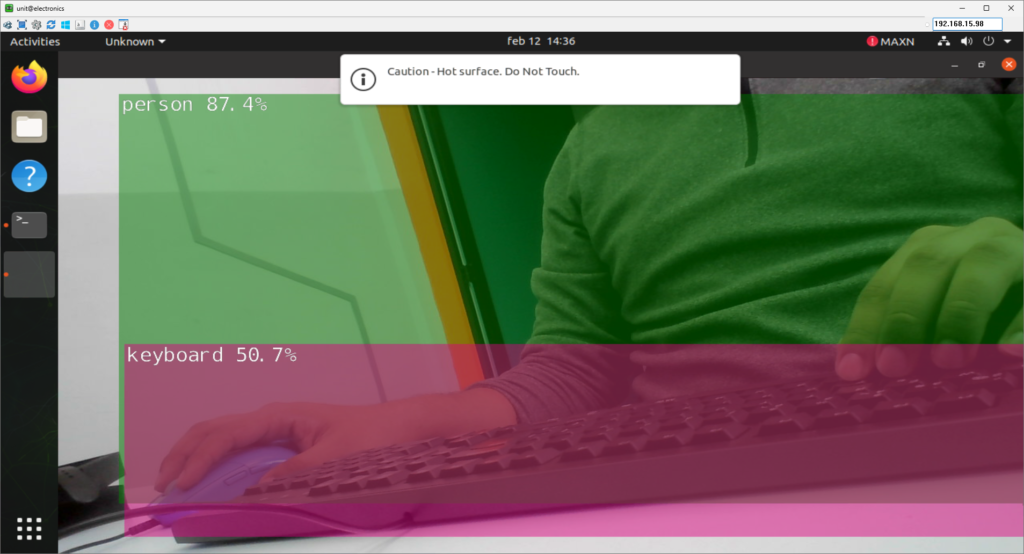

Una vez listo, verás una ventana con el video en vivo donde el sistema dibujará recuadros (bounding boxes) sobre personas, teclados, botellas y más, indicando el nivel de confianza de la detección.

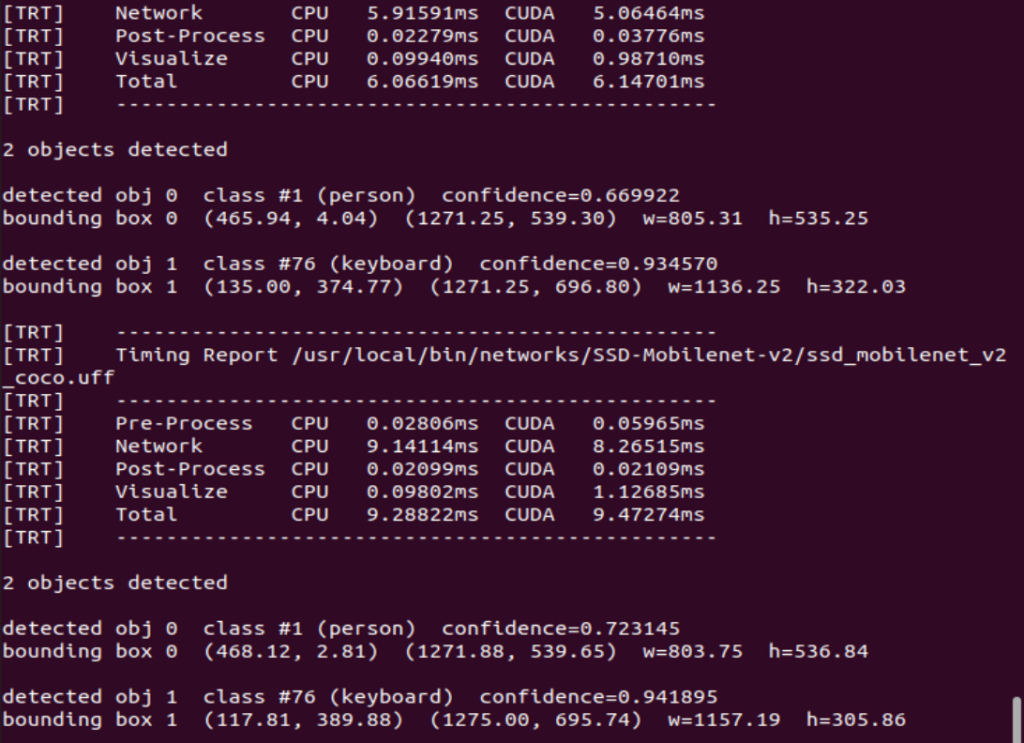

Mientras el modelo de detección se ejecuta, notarás que la terminal se llena de datos técnicos. No te asustes, esta es la “retroalimentación” en tiempo real de la GPU Orin NX.

En esta sección podrás observar:

- Timing Report (TRT): Muestra el tiempo de procesamiento en milisegundos tanto para la CPU como para la GPU (CUDA). Aquí verás por qué la Jetson es tan potente: la GPU suele realizar el trabajo pesado de la red neuronal en una fracción del tiempo que le tomaría al procesador central.

- Object Detection: La terminal te dirá exactamente cuántos objetos detectó en cada cuadro, qué clase de objeto es (persona, perro, silla) y el nivel de confianza (un valor de 0 a 1). Por ejemplo, un

confidence=0.94significa que el modelo está un 94% seguro de lo que está viendo.

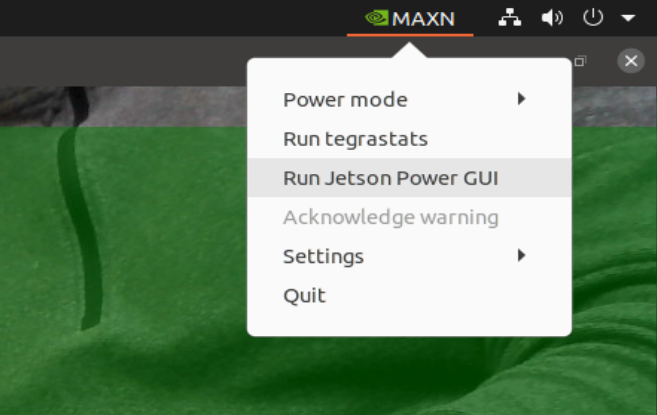

Por otra parte, si quieres ver cómo está “sufriendo” (o relajándose) el hardware de tu reComputer, NVIDIA incluye herramientas gráficas muy completas. Para acceder a ellas, busca en la barra superior del escritorio el menú de configuración de NVIDIA:

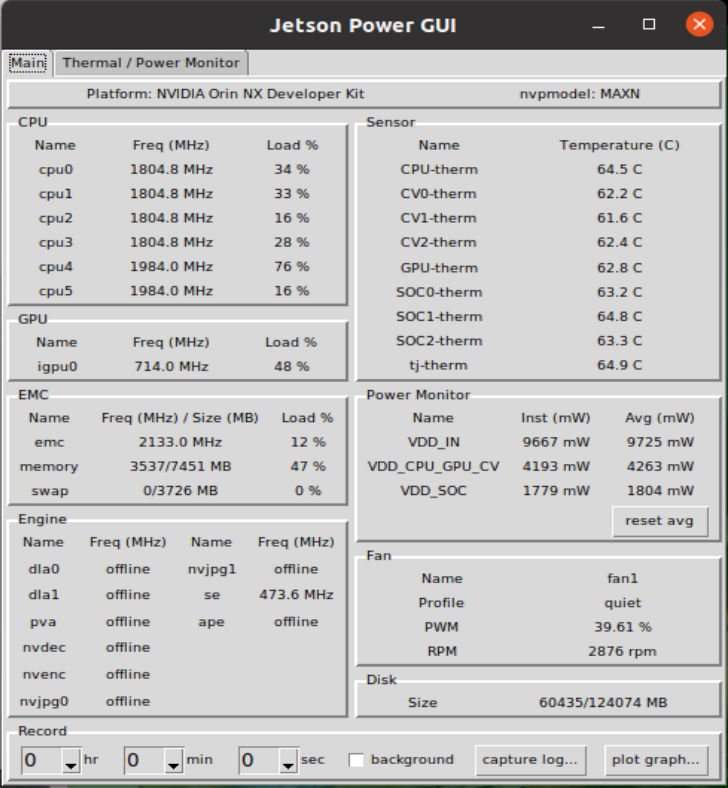

Al seleccionar “Run Jetson Power GUI”, se abrirá un panel de control detallado que te permite monitorear:

- Carga de CPU y GPU: Verás el uso individual de los 6 núcleos del Orin NX y el porcentaje de carga de la GPU.

- Temperaturas: Vital para asegurar que el disipador esté haciendo su trabajo durante procesos largos de IA.

- Consumo Eléctrico: Verás cuántos miliwatts (mW) está consumiendo la placa en tiempo real.

Esta herramienta es ideal para optimizar tus proyectos, ya que te ayuda a decidir si necesitas ajustar la potencia o si tienes margen para ejecutar modelos más pesados.

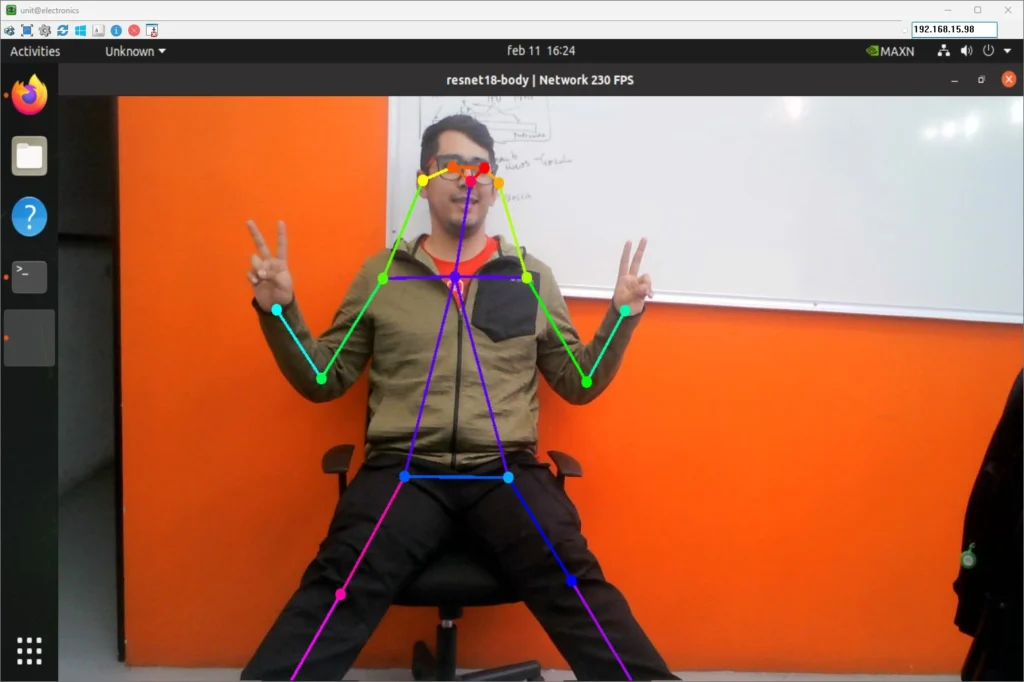

Otros ejemplos

Lo mejor de jetson-inference es que no se limita a detectar objetos. El repositorio está repleto de ejemplos diseñados para explotar las capacidades de visión profunda de la reComputer. Uno de los modelos más visuales y potentes es PoseNet, que utiliza algoritmos de estimación de pose para identificar “esqueletos” humanos en tiempo real.

Para probarlo, simplemente navega a la carpeta de ejemplos de Python dentro del contenedor y ejecuta:

cd python/examples

posenet /dev/video0Este es solo el comienzo. Dentro del mismo contenedor puedes experimentar con:

- Imagenet: Para clasificación de miles de tipos de objetos.

- SegNet: Para segmentación semántica (identificar qué píxeles pertenecen a una carretera, a un edificio o a un peatón).

- ActionNet: Para reconocer acciones o gestos específicos.

Conclusiones

La reComputer J4011 es, sin duda, una de las herramientas más potentes y accesibles para entrar de lleno al mundo del Edge AI. A lo largo de este tutorial, hemos pasado de tener una placa recién desempacada a ejecutar redes neuronales complejas que procesan video en tiempo real, todo de manera local y con un consumo energético eficiente.

La Inteligencia Artificial ya no es algo exclusivo de servidores gigantes; gracias a dispositivos como la Jetson Orin NX, el límite ahora es tu creatividad. Ya sea que quieras construir un robot autónomo, un sistema de seguridad inteligente o una herramienta de análisis deportivo, ya tienes la base técnica para empezar a prototipar.

¡Es hora de experimentar! Cuéntanos en los comentarios qué modelo te sorprendió más o qué proyecto tienes en mente desarrollar con tu reComputer.